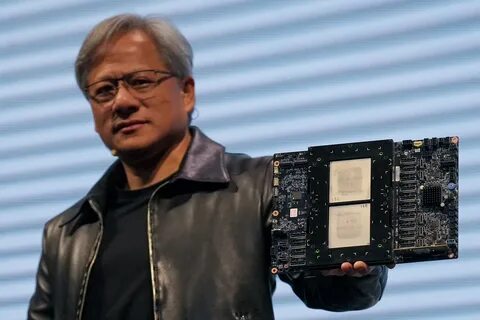

Генеральный директор Nvidia: Искусственный интеллект станет ключом к борьбе с тёмной стороной ИИ В последние годы искусственный интеллект (ИИ) стал неотъемлемой частью нашей жизни, проникая в самые разные сферы — от медицины до финансов. Однако с ростом его возможностей возникает и беспокойство о последствиях, которые могут сопровождать его развитие. Генеральный директор Nvidia Дженсен Хуанг в недавнем интервью затронул важную тему: как использовать ИИ для борьбы с его потенциальными угрозами. По его мнению, именно технологии, созданные для прогресса, могут также стать инструментом в борьбе с тёмной стороной ИИ. Хуанг отметил, что развитие ИИ приносит не только положительные изменения, но также и ряд вызовов, таких как кибератаки, фальсификация данных и манипуляции с информацией.

По его словам, эти угрозы требуют незамедлительных действий, и на эту задачу может ответить именно ИИ. «Мы должны понимать, что технологии – это лишь инструменты. То, как мы их используем, зависит от нас», — подчеркивает Хуанг. Одним из ярких примеров является использование ИИ для разработки методов обнаружения фальшивых новостей и манипулятивной информации. С каждым годом всё больше людей становится жертвами дезинформации, и инструменты ИИ могут помочь в идентификации таких материалов.

Используя алгоритмы машинного обучения, технологии ИИ могут анализировать текстовые и визуальные данные, выявляя паттерны, характерные для поддельной информации. Таким образом, ИИ может быть преобразован в мощный инструмент для защитников правды и надежных источников информации. Однако вызовы, с которыми мы сталкиваемся, не ограничиваются только фальшивыми новостями. Атаки на кибербезопасность представляют собой серьёзную угрозу, и здесь снова на помощь может прийти ИИ. Хуанг заявил, что современные ИТ-компании должны адаптировать свои системы безопасности, внедряя решения на основе ИИ, которые способны мгновенно реагировать на атаки и выявлять аномалии в системах.

«Допустим, у вас есть сеть, которую постоянно атакуют. Традиционные системы безопасности могут не справляться с подобными угрозами. Но ИИ способен анализировать огромное количество данных в режиме реального времени, выявляя потенциальные угрозы и нейтрализуя их до того, как они нанесут вред», — объяснил Хуанг. Такой подход способен значительно улучшить уровень кибербезопасности и защитить как компании, так и обычных пользователей от киберпреступлений. Тем не менее, внедрение ИИ в сферу кибербезопасности предполагает также наличие этических стандартов.

Хуанг подчеркивает важность создания этически обоснованных технологий, которые будут использоваться для выявления и предотвращения угроз, не нарушая при этом права человека. «Нам необходимо garantir, чтобы технологии служили во благо, а не во вред», — добавил он. Творческие индустрии также не остаются в стороне от этой темы. К примеру, использование ИИ в сфере создания контента может быть как полезным, так и опасным. В последнее время наблюдается тренд на использование генеративного ИИ для создания текстов, изображений и музыки.

Это создает новые возможности для художников и авторов, но неизбежно возникает вопрос о вопросах авторского права и этики. Как сохранить баланс между творческими достижениями и соблюдением прав интеллектуальной собственности? На эту тему Хуанг подчеркивает важность правового регулирования в экосистеме ИИ. Он предполагает, что необходимо создавать законы и нормы, которые определяли бы границы допустимого использования ИИ в творчестве. «Мы должны установить правила игры, чтобы сохранить креативность и при этом защитить права авторов», — уверен он. Помимо решения вопросов безопасности и этики, Хуанг также акцентирует внимание на необходимости образовательных программ, направленных на повышение осведомленности о технологиях ИИ.

Он считает, что образование должно охватывать как технические аспекты, так и этические нормы использования ИИ. «Если мы хотим, чтобы общество смогло безопасно взаимодействовать с этой технологией, необходимы просветительские инициативы. Люди должны понимать, что такое ИИ, как он работает и как его можно использовать во благо», — добавляет он. В рамках своей миссии Nvidia активно представляет технологии, помогающие разработать ИИ без ущерба для безопасности и этики. Например, компания инвестирует в проекты, которые направлены на разработку открытых платформ для сотрудничества между учеными, разработчиками и исследователями в области ИИ.

Это позволяет создавать решения, которые учитывают интересы разных сторон и способствуют их взаимодействию ради общего блага. Завершая своё выступление, Хуанг напомнил, что ключевую роль в настоящем и будущем ИИ играют сами пользователи и разработчики. «Мы находимся на распутье, и наше решение, как использовать ИИ, повлияет на наше общество в будущем. Мы можем создать мир, в котором технологии служат на благо человечества, или мир, в котором они используются для манипуляций и контроля. Выбор за нами», — резюмирует он.

В заключение, разговор о тёмной стороне ИИ и возможностях, которыми располагает человеческая мудрость, продолжается. И ведущие специалисты, такие как Дженсен Хуанг, находятся в авангарде этой дискуссии, ставя перед нами важнейший вопрос: можем ли мы создать будущее, в котором ИИ будет служить лишь на благо человечества? Время покажет, но уже сегодня ясно: искусственный интеллект — это не только мощный инструмент, но и огромная ответственность.