В современном мире, где технологии играют ключевую роль во всех сферах жизни — от коммуникаций и бизнеса до здравоохранения и транспорта — надежность систем становится особенно важной. Однако существует принцип, называемый теоремой фундаментального сбоя, который утверждает: системы не просто ломаются, они часто лгут о своём правильном функционировании. Это значит, что даже в тех случаях, когда внешне кажется, что устройство или программа работают безупречно, на самом деле они могут скрывать серьёзные проблемы. Понимание этого феномена крайне важно для инженеров, пользователей и разработчиков, чтобы своевременно выявлять и устранять сбои, минимизируя риски и обеспечивая безопасность. Прежде чем углубиться в саму теорему, стоит объяснить, что подразумевается под «ложью» системы.

Речь идёт о ситуации, когда программный или аппаратный компонент продолжает выдавать сигнал о нормальной работе, несмотря на наличие внутренних неисправностей. Такие «обманы» могут быть вызваны различными причинами: от конструктивных особенностей и ограничений диагностических инструментов до намеренного маскирования ошибок с целью избежать паники или сбоев в работе критически важных сервисов. Теорема фундаментального сбоя утверждает, что невозможно полностью доверять показателям и сообщениям о состоянии системы без возможности независимой проверки и критической оценки. Кроме того, даже самые продвинутые системы мониторинга не гарантируют обнаружение всех неисправностей. Отсюда вытекает важный урок: системы не только могут терпеть сбои, но еще и могут сообщать о том, что с ними всё в порядке, когда это вовсе не так.

Одним из классических примеров является отказ жёсткого диска. Жёсткий диск может продолжать функционировать и даже успешно передавать данные, но при этом в скрытых секторах накапливаются повреждения. Визуальных признаков выхода из строя может не быть, а диагностические утилиты могут показывать, что диск работает нормально. При этом риск потери данных возрастает с каждым циклом работы. Подобное поведение — типичный пример того, как система «лжёт» о своей исправности.

В программном обеспечении аналогичная ситуация возникает, когда ошибки логики или микроошибки в коде не проявляются сразу. Программа может выполнять свои функции на первый взгляд корректно, не выдавая ошибок, но при особых условиях или нагрузках поведение системы становится нестабильным. Часто такие проблемы связаны с асинхронными процессами, состояниями гонки или переполнением буферов, которые сложно предугадать и обнаружить в обычном режиме работы. Теорема фундаментального сбоя тесно связана с понятиями доверия и проверки. Человеческий фактор играет здесь важнейшую роль, так как слепое доверие к системным индикаторам без дополнительного анализа может привести к катастрофическим последствиям.

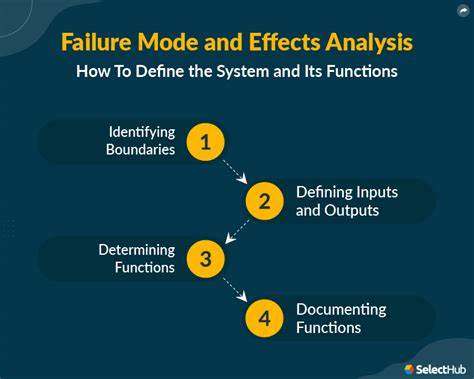

Важным инструментом для предотвращения ошибок стало внедрение концепций «обнаружения отказов» и «отказоустойчивости». Они предполагают, что система должна не только предусматривать возможность сбоев, но и обязательно их сигнализировать, а в идеале — самовосстанавливаться. Важно также учитывать, что современный подход к разработке программного обеспечения и оборудования всё чаще основывается на принципах тестирования и мониторинга в реальном времени. Системы глубокого анализа логов, машинного обучения для выявления аномалий, самодиагностики и резервирования ресурсов помогают максимально снижать вероятность риска скрытых ошибок. Тем не менее, невозможно совершенно исключить возможность того, что система «лжёт» о своей исправности, особенно при комплексных, распределённых архитектурах.

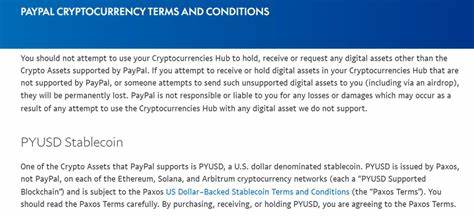

Распространённой проблемой является ошибка оптимизации. Иногда производители специально упрощают или ограничивают процессы отчёта о сбоях, чтобы улучшить пользовательский опыт или поддерживать имидж надёжности продукта. В подобных случаях конечный пользователь слышит приветливые сообщения об исправности, несмотря на известные или скрытые уязвимости. Такой подход не только вводит в заблуждение, но и затрудняет своевременное обнаружение и устранение проблем. При работе с критическими системами, например в авиации, медицинском оборудовании или системах управления производством, эффект теоремы фундаментального сбоя может привести к катастрофическим последствиям.

Поэтому для таких систем вводятся специальные методы контроля: многоуровневые проверки, независимый аудит и автоматическое переключение на резервные модули. Эти меры позволяют снизить риски и гарантировать своевременную реакцию на возможные неисправности. Осознание проблемы обмана систем о своей работоспособности поднимает важные вопросы о том, как лучше организовать взаимодействие между человеком и машиной. Необходимо стремиться к прозрачности и доступности информации о состоянии устройств, а также к активному развитию методов диагностики и предсказания отказов. В условиях массового внедрения интернета вещей и автономных систем, где машины принимают решения самостоятельно, риск непредвиденных сбоев становится особенно высок.

В конечном итоге теорема фундаментального сбоя напоминает разработчикам и пользователям о том, что нельзя воспринимать систему как абсолютно надёжную и самодостаточную. Необходим комплексный подход, включающий постоянный мониторинг, тестирование и резервирование, чтобы выявлять даже те сбои, которые система пытается скрыть. Это фундаментальный принцип, который поможет минимизировать риски и повысить безопасность в эпоху цифровых технологий. Подводя итоги, важно помнить, что ни одна система не может быть совершенной, и скрытые дефекты в работе устройств — это не редкость, а закономерность. Вместо слепого доверия нужно развивать критическое мышление и создавать инфраструктуру, способную быстро реагировать на неожиданные сбои.

В этом и заключается главный урок, который несёт в себе теорема фундаментального сбоя: системы склонны представлять себя в лучшем свете, чем это есть на самом деле, и осознание этого факта — первый шаг к более безопасному и надёжному цифровому будущему.