Мир искусственного интеллекта стремительно развивается, охватывая все новые сферы деятельности, включая научные исследования и публикации. Одной из ключевых площадок для продвижения передовых разработок в области машинного обучения и искусственного интеллекта является ежегодная конференция ICML (International Conference on Machine Learning). Однако с достижениями приходят и новые вызовы, связанные с этикой, ответственным использованием технологий и сохранением научной честности. Одним из таких новых вызовов для исследовательского сообщества стали явления, связанные с использованием скрытых подстроенных подсказок (hidden prompts) в системах больших языковых моделей (LLM). Официальная позиция ICML по этому вопросу стала отражением строгости и ответственности сообщества в борьбе с попытками подрыва процесса рецензирования и научной этики в целом.

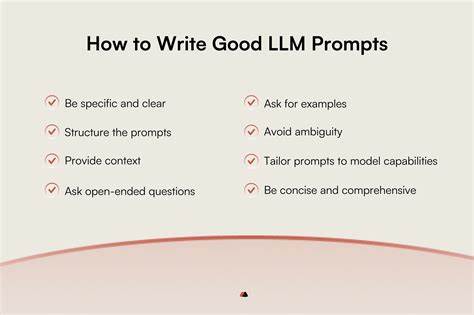

Скрытые подстроенные подсказки — это специальные инструкции или информационные хвосты, встроенные в научные материалы или тексты, которые предназначены для того, чтобы повлиять на обработку моделей ИИ, используемых рецензентами или системами автоматической проверки. Такая тактика может служить попыткой искусственно повысить шансы исследования на положительную оценку, обходя объективный и честный процесс рецензирования. В контексте конференции ICML ее использование считается серьезным нарушением научной этики и квалифицируется как мошенничество. Одним из фундаментальных принципов сообщества машинного обучения является прозрачность и честность при публикации результатов своих исследований. Авторы обязаны полно и честно описывать методы, данные и потенциальные риски, связанные с их работой.

Внедрение скрытых подсказок для манипуляции рецензентами подрывает суть научного метода, который базируется на объективной оценке результатов независимо от авторских намерений. ICML пошла дальше рамок просто запрета таких действий, предоставив четкие рекомендации и этические нормы для авторов и рецензентов. Особое внимание уделяется ответственности за выявление и раскрытие возможных рисков использования методов и приложений, связанных с искусственным интеллектом, включая вопросы дискриминации, приватности и законного соответствия. При этом сама конференция запрещает своим рецензентам использовать LLM для написания отзывов, поддерживая высокий уровень конфиденциальности и интеллектуальной честности. Несмотря на строгие правила, после завершения этапов принятия заявок в ICML 2025 стало известно, что в нескольких принятых докладах все-таки были обнаружены случаи скрытых подстроенных подсказок.

Важно отметить, что организаторы конференции не стали незамедлительно дисквалифицировать эти работы из-за близкой даты проведения мероприятия и уже запланированных путешествий авторов. Вместо этого они связались с авторами, а также передали ситуацию на рассмотрение специальных комитетов надзора и правления ICML, что свидетельствует о серьезном подходе к решению проблемы. Данный прецедент показывает, насколько современное научное сообщество осознает и предупреждает новые формы нарушения этических принципов, связанные с использованием возможностей искусственного интеллекта. Введение правил, учитывающих законодательство, как, например, требования Европейского закона об искусственном интеллекте (EU AI Act), дополнительно подчеркивает важность соблюдения правовых норм и ответственности исследователей. Как результат, конференция ICML выступает символом стремления к сохранению гармоничного баланса между технологическим прогрессом и этическими стандартами.

Участники сообщества понимают, что доверие к науке формируется на основе честности, открытости и профессиональной этики, а попытки подрыва этих основ подрывают не только конкретные исследования, но и репутацию всей отрасли. Помимо борьбы с скрытыми подсказками, ICML уделяет большое внимание другим аспектам этики – такие как предотвращение дискриминации и предвзятости в алгоритмах, защита персональных данных и соблюдение правил конфиденциальности, а также соблюдение стандартов ответственного исследования, включая получение одобрения этических комитетов (IRB) при работе с человеческими субъектами. В перспективе усиление контроля и формализация этических требований станут неотъемлемой частью научного процесса в области искусственного интеллекта. Активное участие международного сообщества в обсуждении и разработке подобных норм способствует повышению качества исследований и укреплению доверия между учеными, разработчиками, обществом и регуляторами. Подводя итог, можно сказать, что борьба с использованием скрытых подстроенных подсказок в ЛЛМ как попыткой манипуляции рецензированием стала важным шагом в укреплении стандартов научной этики и прозрачности.

ICML демонстрирует пример ответственного подхода к новым вызовам, возникающим на стыке науки и технологий, что важно для дальнейшего прогресса в области искусственного интеллекта и сохранения общественного доверия к нему. Внимание к вопросам этичности и ответственности делает исследования не только инновационными, но и справедливыми, что сегодня является ключевым фактором устойчивого развития всей сферы.