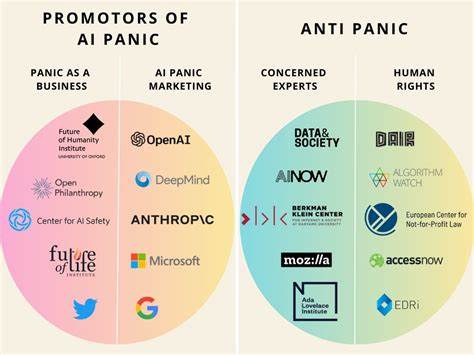

Искусственный интеллект с каждым годом всё больше проникает в нашу жизнь и бизнес, формируя вокруг себя настоящий вихрь ожиданий, страхов и гипотез. Тема ИИ воспринимается порой как что-то фантастическое и непредсказуемое, и многие руководители технологических компаний ощущают давление сделать ставку на AI, зачастую поддавшись панике и страху упустить выгоду. Но что же на самом деле вызывает беспокойство у опытных технических директоров, продвигающих и внедряющих ИИ в корпоративную среду? Именно об этом стоит поговорить, отделяя реальность от шума вокруг новых технологий. Уже более 18 лет наблюдая за технологическими трендами и гипами, можно с уверенностью сказать, что страх перед замещением человека роботом не является главной проблемой. Для настоящих профессионалов внушает опасения совсем другое — необдуманные, поспешные решения, основанные на страхе пропустить тренд, часто ведущие к «дорогим ошибкам».

Во-первых, стоит отметить, за что не стоит переживать. Популярные мифы о полном замещении разработчиков программ искусственным интеллектом не подтверждаются практикой. Технологические инновации всегда переплетались с изменениями ролей специалистов, и грамотные инженеры всегда находили способы адаптироваться и стать еще продуктивнее. Кроме того, автоматизация не отменяет необходимость участия человека в бизнес-процессах – технологии могут помочь собирать данные и выполнять рутинные функции, но принятие решений, учитывающих контекст и нюансы, пока требует человеческого интеллекта. Неумеренный ажиотаж вокруг необходимости строить «стратегию ИИ» для любой компании тоже не всегда оправдан.

Для большинства организаций важнее закрепить базовые операционные компетенции, чем увлекаться попытками внедрять ИИ ради моды. Настоящие же проблемы лежат совсем в другом измерении. Одной из самых глубоких опасностей для бизнеса является угасание критического мышления внутри команд. С появлением возможности быстро получать готовые решения и рекомендации от AI инструментария многие специалисты начинают полагаться на него без должной проверки и анализа. В компании, где некогда работал автор этих наблюдений, даже руководство призывало сотрудников «перестать думать» и просто обращаться к AI.

Это стало катастрофой с точки зрения ответственности и качества работы. Пропуск этапов детального изучения требований пользователей, уклонение от архитектурных решений и проработка бизнес-логики, леность в решении нестандартных задач и отсутствие тщательного тестирования — все это последствия слепой веры в «гения ИИ». Особенно тревожит практика использования AI для ответов на сложные юридические вопросы или в сфере комплаенса без дополнительной проверки — здесь цена ошибки может быть катастрофической. Еще одна важная проблема — это зависимость от так называемой «магической коробки». Многие команды используют AI-модели и сервисы как нечто непостижимое, что работает «само по себе», не стараясь понять внутренние механизмы работы, ограничения и возможные ошибки.

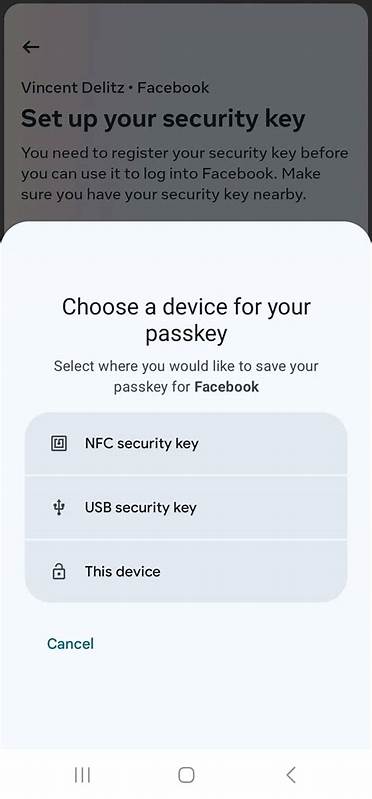

В ряде случаев бизнес-логика оказывается «похоронена» в коде, сгенерированном AI, который никто из команды не может отладить или адаптировать. Кроме того, устройства, созданные искусственным интеллектом, зачастую воспринимаются как временные решения: быстро сгенерированный код не документируется и не анализируется, а значит нагрузка на сопровождение и развитие систем становится непомерно высокой. Это скрытый технический долг, который может выстрелить неожиданно, когда система перестает работать или требует изменений и обновлений. Вторая сторона проблемы безопасности — настоящий тайм-бомба. Модели искусственного интеллекта уязвимы к различным видам атак, включая заражение данных, манипуляцию входными сигналами и выводами, а также попыткам извлечь из моделей конфиденциальную информацию.

Разработчики и команды часто недостаточно серьезно относятся к вопросам безопасности AI-решений, считая, что «это просто ИИ» и не требуя у себя стандартизированного подхода к защите данных и инфраструктуры. Однако, такие упущения в перспективе могут привести к значительным рискам утечки конфиденциальности, нарушению работы сервисов и даже к кризисам корпоративного уровня. На практике уже появляются конкретные примеры, когда AI внедряется для работы с внутренними базами данных и API, но при этом проекты страдают от отсутствия недостаточных мер кибербезопасности. Все эти тревоги вызваны одним глубоким системным вопросом — это утрата базового инженерного мышления и философии работы с технологиями с первых принципов. Самое главное — не забывать, что технологии созданы для решения конкретных реальных проблем.

Если проект превращается в демонстрацию возможностей ИИ без чёткого понимания задачи и ценности, то он обречён на провал. Важно понимать, что все системы могут и будут выходить из строя. Необходимо заранее продумывать сценарии отказа, прорабатывать логирование и мониторинг, а также возможность ручного восстановления. Искусственный интеллект с его сложной и часто непрозрачной логикой требует особенно внимательного отношения к поддержке и обслуживанию. Наконец, вопросы безопасности не должны рассматриваться как нечто дополнительное и опциональное.

Безопасность должна быть встроена в проект с самого начала — только так можно избежать серьезных инцидентов и гарантировать устойчивость системы в долгосрочной перспективе. Поэтому подход к внедрению и использованию AI должен быть таким же дисциплинированным, как и при разработке любого программного обеспечения. На практике, CTO и команды, которые достигают лучших результатов, — те, кто задаёт правильные вопросы и не боится тщательно проверять собственные решения. Это вопросы о том, действительно ли решается оптимальная задача, насколько система устойчива к возможным сбоям и насколько хорошо реализованы меры безопасности. Опыт показывает, что именно такие подходы позволяют избегать дорогих ошибок и создавать по-настоящему работающие решения, которые не зависимы от модных тенденций.

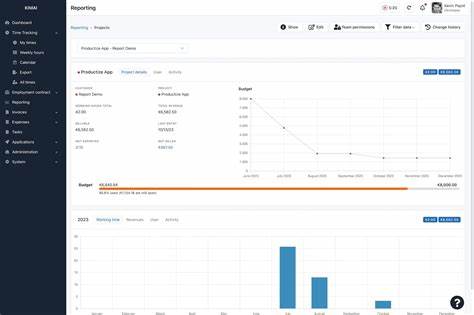

Стоит отметить, что боязнь AI не означает нежелание работать с ним. Напротив, многие профессионалы активно интегрируют ИИ в свои повседневные процессы, используя его как мощный инструмент для повышения эффективности и качества работы. Это проявляется в сферах быстрого создания прототипов, сбора данных и аналитики, составления отчётов, а также поддержки процессов анализа кода и документации. И ключевая мысль — ИИ не заменяет инженера, а дополняет, усиливает его возможности. В целом, настоящая проблема не в самой технологии, а в принятии решений под давлением общественного мнения и неполной информации.

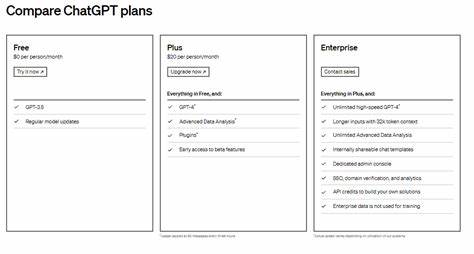

Многие руководители чувствуют, что вынуждены создавать так называемую «стратегию ИИ» только потому, что это модно или ожидаемо рынком. В реальности лучшая стратегия — это сосредоточиться на решении реально значимых задач, объективно оценить возможности ИИ и строить применение технологии исключительно там, где она действительно добавляет ценность бизнесу. Будущее внедрения искусственного интеллекта видится в более приземленных и технически трезвых реализациях. Самые успешные проекты будут не громкими демонстрациями возможностей AI, а стабильными, сфокусированными решениями, которые решают конкретные, измеримые проблемы и вписываются в долгосрочную стратегию компании. Такой подход позволит избежать дорогих провалов, а также обеспечит равновесие между инновациями и ответственным бизнес-управлением.

В свете всего сказанного можно сделать важный вывод: страх – естественная реакция на новые технологии, но именно дисциплина, критическое мышление и инженерное мастерство помогут сделать ИИ действительно полезным и безопасным инструментом для бизнеса и общества.