В эпоху, когда искусственный интеллект (ИИ) все больше формирует наше цифровое пространство, мы стоим на критическом перекрестке технического прогресса и этических проблем. В интервью с Делфином Варгезе, соучредителем и директором по доходам компании AdCounty Media, рассматривается сложная взаимосвязь между ИИ и формированием "эха-камер", цифровых пузырей, которые могут усиливать наши предвзятости и ограничивать наше восприятие разнообразных точек зрения. Основной темой обсуждения являются этические последствия, связанные с использованием ИИ, и стратегии для смягчения их негативного влияния. Варгезе подчеркивает, как алгоритмы ИИ могут невольно усиливать существующие предвзятости, что может углублять социальные разногласия. Он акцентирует внимание на необходимости прозрачности в развитии и внедрении ИИ, а также на том, как технологии могут быть использованы для выявления и разрушения этих эха-камер, способствуя созданию более сбалансированной и разнообразной цифровой экосистемы.

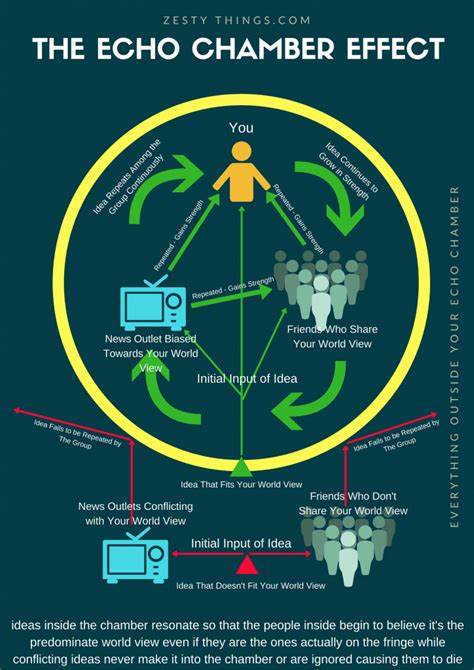

Одной из основных проблем, которую Варгезе обсуждает, является то, как алгоритмы ИИ могут непреднамеренно укрепить предвзятости и создать эхо-камеры. В современном мире, полагающемся на ИИ, такие последствия могут иметь серьезные реперкуссии. Интеграция ИИ может приводить к созданию эха-камер, в которых пользователи сталкиваются с информацией, подтверждающей их взгляды, в то время как альтернативные мнения игнорируются. Это происходит потому, что алгоритмы ИИ обрабатывают исторические данные, которые иногда могут быть искажены и усиливать существующие предвзятости. Основная цель ИИ — это вовлеченность пользователей, а значит, он может создавать "фильтры пузырей", в рамках которых пользователи получают лишь ту информацию, которая соответствует их точке зрения.

Это приводит к ограничению доступа к новым идеям и сужает горизонты восприятия. По мнению Варгезе, этические последствия использования ИИ для создания эха-камер весьма значительны. Они могут углублять социальные разногласия и содействовать поляризации точек зрения, что в свою очередь diminishes the essence of social cohesion. Эти камеры поддерживают информацию, соответствующую мнению пользователя, что увеличивает вероятность манипуляции и дезинформации. Кроме того, эхо-камеры препятствуют соприкосновению с альтернативными взглядами, что затрудняет критическое осмысление информации.

Решение этих проблем, по мнению эксперта, требует обучения алгоритмов ИИ на разнообразных наборов данных. Прозрачность в разработке и внедрении алгоритмов также может сыграть значительную роль в выявлении и устранении предвзятостей. Пользователи должны получить больший контроль над предпочтениями контента, а регулярные аудиты ИИ-систем помогут предотвратить распространение предвзятостей и способствовать различным точкам зрения. Что касается проектирования ИИ-систем, способствующих разнообразию мнений и разрушению эха-камер, Варгезе подчеркивает важность обучения моделей на множестве разных данных. Это поможет снизить риск формирования эха-камер и предоставить пользователям доступ к альтернативным точкам зрения.

Также важно понимать, как контент отбирается и фильтруется, поскольку эта прозрачность является ключом к разрушению эха-камер. Помимо этого, ИИ может быть использован для выявления и решения проблемы эха-камер в онлайн-сообществах. С помощью анализа сетевой активности, анализа содержания и изучения паттернов взаимодействия, ИИ может обнаруживать сообщества, которые взаимодействуют только между собой и имеют little or no contact with outside communities. Анализ постов и тем, обсуждаемых внутри сообщества, также может помочь в выявлении эха-камер, свидетельствующих о нехватке разнообразия. Варгезе настоятельно призывает к диверсификации контентных потоков, чтобы обеспечить użytkowników альтернативной информацией, не согласующейся с их собственными взглядами.

Генерируемые ИИ личные подсказки могут помочь пользователям исследовать различные мнения, что способствует более сбалансированному подходу к восприятию информации. Еще одной важной темой обсуждения стало обеспечение точности и беспристрастности контента, созданного с помощью ИИ. Варгезе утверждает, что необходимо обучать модели ИИ с использованием инклюзивных наборов данных. Регулярный аудит и обновление тренировочных данных являются важными аспектами в борьбе с предвзятостями контента. Использование инструментов для выявления и смягчения предвзятостей поможет избежать создания эха-камер.

Идентификация и применение таких техник, как переспределение, перепроба и уменьшение влияния, могут существенно повлиять на устранение рисков, связанных с эхо-камерами. Наконец, человеческий надзор остается критически важным фактором, особенно в тех случаях, когда ставки высоки. Редакционная надзор и механизмы обратной связи могут помочь выявить неточности и обеспечить справедливость создания контента с помощью ИИ. Таким образом, важно сохранять бдительность и применять инновационные подходы в этой динамичной области. Как подчеркивает Варгезе, нашу цель — не только использовать потенциал ИИ, но и делать это с учётом этических норм и принципов.

В условиях быстро меняющегося цифрового мира необходимо создавать более инклюзивное и справедливое общество, в котором каждый человек будет иметь возможность получить доступ к разнообразным точкам зрения. Это ключ к построению здорового информационного пространства, где каждая точка зрения заслуживает уважения и внимательного рассмотрения.